Autores sin derechos y obras sin autor

Los creadores reclaman su trozo del pastel IA. Los modelos de generación de imágenes por IA no hubieran sido posibles sin la obra de fotógrafos y artistas.

Los algoritmos de generación de texto (GPT, Bloom…) e imágenes (Stable Difussion, Midjourney, Dall-e 2…) tienen un problema que van a tener que resolver tarde o temprano: los derechos de autor.

Este tipo de algoritmos se entrenan con material existente, en su mayoría material creado por personas. Los que se basan en texto se han entrenado con material de internet, escritos en todo tipo de lenguajes y sobre todo tipo de temas, los de generación de imágenes, se han entrenado con repositorios de artistas y sitios de stock de imágenes, o de datasets hechos a partir de esas y otras fuentes.

¿Qué pasó? Pues que cuando estas trabajando en algo que no sabes si va a funcionar (y los inviernos de la inteligencia artificial son un precedente muy presente), en lo último que piensas es en los derechos de autor. Piensas, que mejor pedir perdón que pedir permiso.

Esta claro que no es lo mismo el texto que la imagen, que cada formato tendrá que resolver este problema a su manera. Incluso, independientemente del formato, podemos diferenciar dos problemas diferentes, con soluciones diferentes.

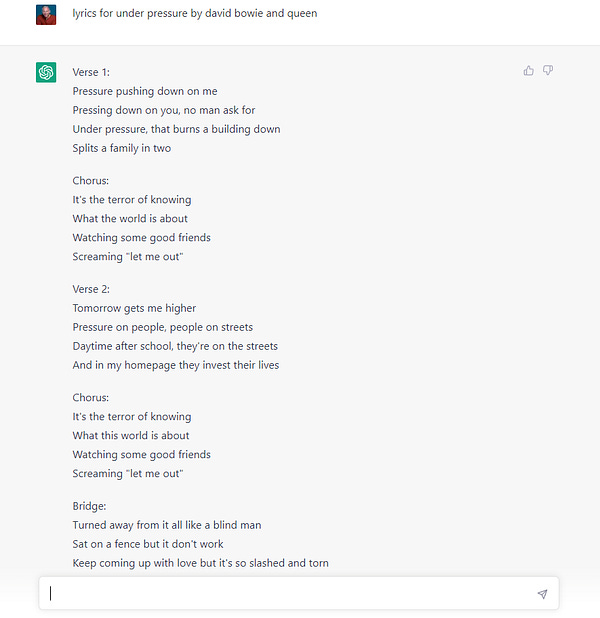

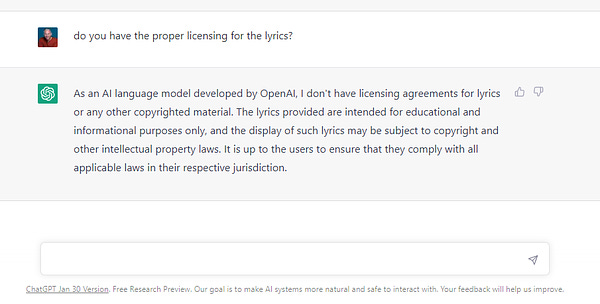

Uno es el de los derechos de copia clásicos (copyright) que tendrían que ver con el uso directo de contenido para generar un contenido idéntico o demasiado similar.

Otro es el de los derechos de uso para entrenamiento (por inventar podríamos llamarlo trainingright) para generar contenido inspirado en ese contenido.

El primer caso esta claro, el segundo es algo tan nuevo que mucha gente intenta colarlos como del primer tipo. Pero esta claro que no es exactamente lo mismo. La copia exacta es una cosa y la “inspiración“ para crear otra cosa es algo diferente.

— David, David, el primer tipo no tiene sentido en este caso ya que no copian sino que en todos los casos generan contenido original.

Sí, en general es así, pero también hay casos en los que copian y generan texto copiado con derechos sin pagar a nadie. Hay muchas casuísticas pero un ejemplo de ello son las letras de canciones.

Lo que ha pasado a estas alturas de la película es que ya tenemos las primeras demandas contra las IA’s de generación de contenido.

La más llamativa es contra Open AI, Github y Microsoft por el uso del código de Github para la creación de Github Copilot. Parece claro que el uso del código de los usuarios de Github (algunos obligan al uso de una licencia para quien quiera usar su código) para generar código nuevo es un problema. Tiene sentido, ya que no se respetan las licencias del código que ha sido usado durante el entrenamiento.

Otra menos llamativa contra Midjourney, Devian Art y Stability.ai realizada por los mismos de la demanda de Github Copilot, en representación de 3 artistas (la más conocida de las 3 seguramente sea Sarah Andersen). En este caso por el uso de imágenes para el entrenamiento de algoritmos de generación de imagen. En mi opinión, lo tienen más complicado para probarlo, su base técnica ya ha sido rebatida por algunos tecnólogos.

Otros que han saltado son los de Getty Images contra los de Stability.ai (los creadores de Stable Diffusion). No sé cómo van a basar en este caso la acusación pero está más que claro que han usado sus imágenes. Nadie lo pone en duda.

Estos ejemplos bastan para entender que la cosa está movida. Los que han creado los algoritmos saben que no han hecho bien las cosas, pero el daño ya está hecho. Ya hay un algoritmo open, Stable Diffusion, que ha sido abierto a la comunidad.

Otro punto a resolver, además de compensar a los autores, es dar respuesta a la pregunta: ¿De quién son los derechos de las obras creadas por estos algoritmos?

Unos dicen que a los que han generado el prompt (la frase que se usa con el algoritmo para iniciar la generación de texto o imagen). Otros, que al algoritmo (los menos).

Pero atendamos a la definición de los derechos de autor.

“El derecho de autor protege la obra que es fruto del intelecto del ser humano.”1

Ha de ser un humano o no ser nadie. Y en el caso de imágenes, de esta segunda forma lo ve también la U.S. Copyright Office, que ha decidido que las imágenes realizadas con IA no pueden tener copyright.

De momento, los únicos movimientos que parecen ir en buena dirección son los de intentar compensar a los autores de alguna forma. Lo está haciendo Shutterstock (otra empresa de stock de imágenes), que ha hecho una alianza con Open AI (el creador de Dall-e 2) para integrarlo en su web, es abrir un fondo para compensar a los fotógrafos de los cuáles se usen fotos para entrenamiento.

También se ha revolucionado un poco el mundo del SEO y de los que viven del contenido en internet en general. El uso de algoritmos de generación de texto junto a los buscadores pone en peligro el tráfico de muchos sitios web. ChatGPT, o Bing Chat, o Bard, o el que venga puede hacer que la gente pinche menos en los enlaces de los resultados de búsqueda.

Eso será otra batalla, pero me da pie a introducir una nueva variable para el futuro de la generación de contenidos.

Vale, los que han creado los algoritmos no lo han hecho bien, pero ya está hecho. ¿A partir de ahora qué? Yo creo que podríamos aprovechar para empezar a crear algunos estándares para el respeto del contenido ajeno. Me explico.

En internet ya existe algo llamado robots.txt, que no es otra cosa que un fichero de texto que ponemos en la raíz de un dominio para indicarle a los robots (los crawlers y otras arañas) lo que pueden o no pueden hacer en nuestra web. ¿Por qué no usarlo para indicarle a los algoritmos (o mejor dicho, a los que montan los datasets de entrenamiento) lo que pueden o no pueden usar para entrenar? O incluso crear un ai.txt específico, tal y como también existen los ads.txt o humans.txt.

Otra opción más proactiva para vídeo e imagen sería crear una plataforma donde subir tus imágenes para evitar que los datasets la usen. Un lugar donde la gente que monta los datasets vaya para consultar lo que debe excluir de su dataset. No sería necesario subir el material a la plataforma, se podría usar el método de huella digital (que usan plataformas como Take it down). La idea es hacer algo así como una lista Robinson de imágenes y vídeos.

En redes sociales podríamos usar una convención para que el que no quiera que se use su contenido lo pueda indicar, algo así como el uso de hashtag en las publicaciones o en la bio. En Mastodon, por ejemplo, se usan los hashtags #nobot, #nosearch y #noindex con similar intención (aunque no se respetan demasiado a decir verdad).

Y por otro lado, si vas a crear un algoritmo de generación de texto o imagen, intenta crearlo con contenido aportado por la gente, no cojas nada sin preguntar antes. En ese sentido, iniciativas como Open Assistant parece que van por buen camino (y ojo que es una iniciativa de LAION, que es quien montó el dataset de entreno de Stable Diffusion, que contiene un 47% de fotos de stock).

La parte buena de todo esto es que todo se mueve muy rápido y los algoritmos evolucionan. Aparecen nuevas versiones (la 2 de Stable Diffusion es un poco más respetuosa con los artistas por ejemplo) y nuevos algoritmos. Espero que también se aproveche para corregir malos hábitos para el entrenamiento y ningún autor salga perjudicado.

Despedida y cierre

Y hasta aquí este tema de los derechos de autor en la inteligencia artificial. Es un tema que ni mucho menos está cerrado aún y del cual veremos cambios hasta que no se llegue a un consenso. Si el tema os parece interesante mínimamente os recomiendo un par de episodios de podcasts:

Este episodio es una entrevista a Marelisa Blanco, abogada especializada en derecho y propiedad intelectual, habla del tema de esta newsletter.

Este episodio es una entrevista a Carlos Muñoz, responsable legal de HuggingFace, que habla de un tema paralelo que no he tocado, los derechos que aplican a los algoritmos y la información involucrada (modelos, pesos, datasets…).